Le 3 février 2026, Google a mis à jour sa documentation officielle pour clarifier les limites techniques de Googlebot. Le robot d’exploration traite désormais les 2 premiers Mo d’un fichier HTML pour l’indexation dans Google Search, contre 15 Mo précédemment documentés. Cette distinction entre exploration (crawl) et indexation représente un changement majeur dans la communication de Google sur ses capacités techniques. Les fichiers PDF conservent une limite plus élevée de 64 Mo. Pour la majorité des sites web dont les pages HTML pèsent moins de 100 Ko, cet ajustement n’aura aucun impact pratique.

Qu’a annoncé Google concernant les limites de Googlebot ?

Google a clarifié le 3 février 2026 que Googlebot indexe les 2 premiers Mo d’un fichier HTML et 64 Mo d’un PDF, tandis que l’infrastructure de crawl télécharge jusqu’à 15 Mo par défaut.

La mise à jour de la documentation Google du 3 février 2026 a introduit une clarification technique importante concernant le fonctionnement de Googlebot. Cette annonce a généré des réactions contrastées dans la communauté SEO, certains parlant d’une réduction drastique de 86,7% des limites d’exploration.

En réalité, Google n’a pas réduit ses capacités techniques. L’entreprise a simplement clarifié la différence entre deux processus distincts : l’exploration (crawl) et l’indexation. Selon la documentation officielle de Google Developers, Googlebot peut télécharger jusqu’à 15 Mo de données par ressource, mais seuls les 2 premiers Mo d’un fichier HTML sont traités pour l’indexation dans Google Search.

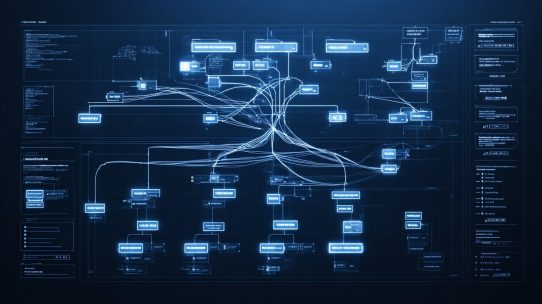

Cette distinction révèle une architecture en deux étapes dans le traitement des contenus web par Google. La première étape concerne le téléchargement des fichiers par l’infrastructure de crawl, la seconde concerne l’analyse sémantique et l’indexation du contenu pour le classement dans les résultats de recherche.

Les fichiers PDF bénéficient d’un traitement différencié avec une limite d’indexation de 64 Mo, reflétant la nature documentaire de ce format et son usage dans la publication de rapports, études et documents techniques volumineux.

Différence entre exploration (crawl) et indexation

L’exploration télécharge les fichiers (limite 15 Mo), tandis que l’indexation analyse et classe le contenu pour les résultats de recherche (limite 2 Mo pour HTML).

La distinction entre crawl et indexation constitue un élément fondamental pour comprendre l’annonce de Google. Ces deux processus interviennent à des moments différents dans le traitement d’une page web par Googlebot.

Le crawl représente la phase de téléchargement. Lorsque Googlebot visite une URL, il envoie une requête HTTP au serveur et récupère le contenu de la ressource. Cette étape mobilise la bande passante du serveur et consomme du crawl budget. L’infrastructure de crawl de Google peut télécharger jusqu’à 15 Mo par fichier selon la documentation technique officielle.

L’indexation intervient après le téléchargement. Cette phase consiste à analyser le contenu HTML, extraire les signaux de pertinence, identifier les entités sémantiques, évaluer la qualité du contenu et stocker les informations pertinentes dans l’index de Google. C’est à cette étape que la limite de 2 Mo s’applique pour les fichiers HTML.

Un troisième processus mérite mention : le rendering. Googlebot peut crawler une page (télécharger le HTML) mais ne jamais la rendre (exécuter le JavaScript), créant des pages zombies techniquement crawlées mais avec un contenu incomplet dans l’index de Google. Ce phénomène affecte particulièrement les applications web modernes utilisant React, Vue.js, Angular et autres frameworks JavaScript.

| Processus | Fonction | Limite technique | Ressource consommée |

|---|---|---|---|

| Crawl | Téléchargement des fichiers | 15 Mo (HTML/CSS/JS) | Crawl budget, bande passante serveur |

| Indexation | Analyse et classification du contenu | 2 Mo (HTML), 64 Mo (PDF) | Capacité de traitement sémantique |

| Rendering | Exécution du JavaScript | Non documentée | Render budget, ressources serveur |

Les trois limites techniques à connaître

Googlebot applique trois limites distinctes : 2 Mo pour l’indexation HTML, 64 Mo pour les PDF, et 15 Mo pour le téléchargement de l’infrastructure de crawl.

Google applique des limites différenciées selon le type de fichier et le processus concerné. Ces seuils techniques reflètent les priorités de Google en matière d’allocation de ressources et les contraintes opérationnelles de son infrastructure d’exploration.

La limite de 2 Mo pour les fichiers HTML s’applique aux données non compressées. Cette précision revêt une importance capitale : même si votre serveur compresse les fichiers avec GZIP ou Brotli (réduisant la taille de transfert à 500 Ko par exemple), c’est la taille décompressée qui compte pour atteindre la limite de 2 Mo. Googlebot décompresse systématiquement les fichiers avant de les analyser.

Les fichiers PDF bénéficient d’une limite de 64 Mo, soit 32 fois supérieure à celle du HTML. Cette différence s’explique par l’usage documentaire des PDF : rapports annuels, livres blancs, études scientifiques, documentation technique et guides complets nécessitent souvent plusieurs dizaines de Mo pour conserver la qualité graphique et la richesse du contenu.

L’infrastructure de crawl de Google, documentée séparément dans la section Crawling Infrastructure, mentionne une limite par défaut de 15 Mo pour les crawlers et fetchers de Google. Cette limite s’applique au téléchargement initial, avant toute décision d’indexation.

| Type de fichier | Limite d’indexation | Taille moyenne réelle | Sites concernés par la limite |

|---|---|---|---|

| HTML | 2 Mo (non compressé) | 50-150 Ko | Sites avec pages infinies, catalogues produits massifs |

| 64 Mo | 500 Ko – 5 Mo | Éditeurs de rapports longs, documentation technique exhaustive | |

| CSS | 15 Mo (crawl) | 20-100 Ko | Frameworks CSS non optimisés |

| JavaScript | 15 Mo (crawl) | 100-500 Ko | Applications web avec bundles non optimisés |

Une fois la limite atteinte, Googlebot cesse immédiatement le fetch et n’envoie que la partie déjà téléchargée pour traitement d’indexation. Si une page HTML de 3 Mo est servie, seuls les 2 premiers Mo seront analysés et indexés, le dernier Mo sera perdu pour le référencement.

Impact réel sur le référencement de votre site

Pour 95% des sites web dont les pages HTML pèsent moins de 100 Ko, l’impact est nul. Les sites affectés sont les plateformes e-commerce avec chargement infini et les agrégateurs de contenu massif.

L’impact de cette limite varie considérablement selon l’architecture du site et le volume de contenu par page. La communauté SEO a rapidement analysé les conséquences pratiques de cette clarification.

La majorité des sites web n’atteindront jamais la limite de 2 Mo. Une page HTML typique pèse entre 50 Ko et 150 Ko non compressée. Les outils Chrome DevTools Network révèlent que même les sites médias riches en contenu restent largement sous ce seuil. Un article de blog de 3000 mots avec images intégrées en base64 représente environ 200-300 Ko de HTML.

Les sites potentiellement affectés appartiennent à des catégories spécifiques : plateformes e-commerce avec chargement infini (infinite scroll) générant des pages HTML contenant des centaines de produits, agrégateurs de données affichant des tableaux massifs sans pagination, sites d’annonces immobilières listant des milliers de propriétés sur une page unique, forums avec chargement automatique de centaines de messages, et pages de résultats compilant du contenu provenant de multiples sources.

Les conséquences d’un dépassement sont significatives. Si du contenu stratégique (call-to-action, données structurées schema.org, liens internes importants) se situe au-delà de la limite de 2 Mo, il ne sera jamais indexé. Google ne voit pas ce qui se trouve après la coupure. L’indexation incomplète peut entraîner une perte de visibilité organique, un classement inférieur pour les requêtes ciblées et une incompréhension des signaux sémantiques de la page.

| Taille de page HTML | Niveau de risque | Action recommandée | Urgence |

|---|---|---|---|

| < 500 Ko | Aucun risque | Aucune action nécessaire | N/A |

| 500 Ko – 1 Mo | Risque faible | Surveillance préventive | Basse |

| 1 Mo – 2 Mo | Risque modéré | Audit technique et optimisation | Moyenne |

| > 2 Mo | Risque élevé | Refonte architecture + pagination | Haute |

Les données de Search Engine Journal (2026) indiquent que moins de 2% des sites web dépassent la limite de 1 Mo par page HTML. Les sites e-commerce représentent 60% de ces cas, suivis des sites d’actualités (25%) et des plateformes d’agrégation (15%).

Comment vérifier la taille de vos fichiers HTML ?

Utilisez Chrome DevTools (onglet Network), Google Search Console (URL Inspection Tool), ou des crawlers SEO comme Screaming Frog et Sitebulb pour auditer la taille réelle non compressée de vos pages.

Plusieurs méthodes permettent de vérifier si vos pages dépassent les limites de Googlebot. Chaque approche offre des avantages spécifiques selon l’échelle de votre audit.

Chrome DevTools constitue la méthode la plus rapide pour une vérification ponctuelle. Ouvrez les Developer Tools (F12), accédez à l’onglet Network, rechargez la page et examinez la taille du document HTML principal. Attention : l’onglet Network affiche par défaut la taille de transfert (fichier compressé). Pour obtenir la taille non compressée pertinente pour les limites de Googlebot, ajoutez la colonne « Size » qui montre la taille réelle décompressée.

Google Search Console propose l’URL Inspection Tool, source officielle pour comprendre ce que Googlebot a réellement crawlé, rendu et indexé. Cet outil indique si Googlebot a réussi à récupérer la page, si elle était autorisée par robots.txt, quel code HTTP le serveur a retourné, si le rendering a réussi, et quelle version finale a été indexée. Cette approche garantit une vision exacte de la perspective de Google.

Les crawlers SEO permettent des audits à grande échelle. Screaming Frog SEO Spider, Sitebulb et Ahrefs Site Audit peuvent analyser des milliers d’URL et identifier les pages dépassant un seuil de taille défini. Ces outils génèrent des rapports exportables listant les pages problématiques par ordre décroissant de taille, facilitant la priorisation des optimisations.

Dave Smart a développé un outil de simulation dans Tame the Bots qui limite les fichiers texte à 2 Mo, permettant aux développeurs de tester si leurs réponses HTML seraient tronquées par le crawler de Google. Cette simulation reproduit le comportement de Googlebot pour identifier précisément où se situe la coupure.

La méthode manuelle « View Page Source » reste accessible : clic droit sur la page, « Afficher le code source de la page », puis vérification de la taille du fichier. Cette approche convient pour des vérifications rapides mais manque de précision pour les audits systématiques.

| Méthode | Échelle | Précision | Coût | Cas d’usage optimal |

|---|---|---|---|---|

| Chrome DevTools | Page unique | Très élevée | Gratuit | Vérification ponctuelle pendant le développement |

| Google Search Console | Page unique | Maximale (source officielle) | Gratuit | Diagnostic de problèmes d’indexation |

| Screaming Frog | Jusqu’à 500 URL (gratuit), illimité (payant) | Élevée | 0€ ou 259€/an | Audit technique complet de site |

| Sitebulb | Illimité | Élevée | À partir de 35€/mois | Audits réguliers avec visualisations avancées |

| Ahrefs Site Audit | Selon abonnement | Élevée | À partir de 99$/mois | Monitoring continu avec alertes automatiques |

Pour une analyse approfondie, combinez plusieurs méthodes : utilisez Chrome DevTools pour identifier rapidement les pages suspectes, validez avec Google Search Console pour confirmer la perspective de Googlebot, et déployez un crawler SEO pour automatiser la surveillance à l’échelle du site.

Solutions pour optimiser vos pages volumineuses

Implémentez la pagination pour diviser le contenu, activez le lazy loading pour charger le HTML à la demande, et placez les éléments critiques (données structurées, liens) en début de document.

Si votre audit révèle des pages dépassant ou approchant la limite de 2 Mo, plusieurs stratégies d’optimisation permettent de résoudre ce problème tout en préservant l’expérience utilisateur.

Pagination

La pagination représente la solution la plus efficace pour les contenus volumineux. Au lieu de charger des centaines de produits ou d’articles sur une page unique, divisez le contenu en segments de 20, 50 ou 100 éléments par page. Cette approche réduit drastiquement la taille HTML, améliore le temps de chargement, facilite la navigation utilisateur et optimise le crawl budget en créant des URLs distinctes pour chaque segment. Ajoutez des balises rel= »prev » et rel= »next » pour indiquer à Google la relation entre les pages paginées.

Lazy loading intelligent

Le lazy loading intelligent permet de charger le HTML à la demande plutôt que d’inclure tout le contenu dans le document initial. Utilisez JavaScript pour récupérer du contenu additionnel lorsque l’utilisateur scrolle ou clique sur « Voir plus ». Cette technique réduit la taille du HTML initial tout en conservant l’accès au contenu complet. Attention : assurez-vous que Googlebot peut accéder au contenu important sans interaction JavaScript, car le render budget reste limité.

Priorisation du contenu critique

Placez les éléments SEO importants en début de document HTML : métadonnées OpenGraph et Twitter Cards, données structurées schema.org (Product, Article, Organization), liens internes stratégiques vers les pages prioritaires, contenu textuel principal avec les mots-clés cibles, et call-to-action primaires. Cette organisation garantit que même si la limite est atteinte, les signaux essentiels ont été indexés.

Optimisation du code HTML

L’optimisation du code HTML réduit le poids sans perte de fonctionnalité. Minifiez le HTML en supprimant les espaces, retours à la ligne et commentaires inutiles. Évitez d’intégrer des styles CSS inline volumineux : utilisez des feuilles de style externes. Remplacez les images base64 intégrées dans le HTML par des références externes via balise img. Nettoyez le code généré par les CMS en supprimant les classes CSS inutilisées et les attributs redondants.

Segmentation par catégorie pour l’e-commerce

Pour les sites e-commerce, la segmentation par catégorie offre une solution architecturale. Au lieu de créer une page « Tous les produits » avec des milliers d’items, structurez votre catalogue en catégories et sous-catégories distinctes. Cette approche distribue le contenu sur plusieurs URLs, chacune restant sous la limite de 2 Mo tout en améliorant la pertinence thématique pour Google.

| Technique d’optimisation | Réduction taille estimée | Difficulté implémentation | Impact SEO |

|---|---|---|---|

| Pagination | 70-90% | Moyenne (modification architecture) | Très positif (meilleur crawl budget) |

| Lazy loading HTML | 50-80% | Élevée (développement JavaScript) | Neutre si bien implémenté |

| Minification HTML | 10-25% | Faible (outils automatisés) | Neutre |

| Externalisation images base64 | 30-60% | Faible (modification templates) | Positif (améliore vitesse) |

| Segmentation catégorielle | 60-85% | Élevée (refonte architecture) | Très positif (pertinence thématique) |

Les fichiers PDF volumineux nécessitent une approche différente. Si vos rapports dépassent 64 Mo, divisez-les en chapitres distincts publiés séparément. Créez une page HTML de sommaire avec liens vers chaque chapitre PDF. Cette structure améliore l’indexation, facilite la navigation et permet aux utilisateurs de télécharger uniquement les sections pertinentes.

Crawl budget et gestion des ressources serveur

Le crawl budget est le nombre d’URLs que Googlebot peut et veut crawler, déterminé par le taux de crawl (serveur) et la demande de crawl (popularité des pages).

La question des limites de fichiers s’inscrit dans un contexte plus large : la gestion du crawl budget par Google. Ce concept définit la quantité de ressources que Google alloue à l’exploration de votre site.

Le crawl budget se décompose en deux éléments selon la documentation officielle de Google Developers (2017). Le crawl rate limit représente le nombre maximum de connexions simultanées que Googlebot peut utiliser pour crawler votre site, et le temps d’attente entre les fetchs. Ce taux est déterminé par la réactivité de votre serveur : si Google détecte que votre serveur est en difficulté (latence élevée, timeouts, erreurs 5xx), il réduit automatiquement son taux de crawl pour éviter de surcharger votre infrastructure. Vous pouvez définir manuellement une limite inférieure dans Google Search Console.

La crawl demand représente le nombre d’URLs que Google souhaite crawler sur votre site, déterminé par la popularité des URLs (pages fréquemment consultées par les utilisateurs) et la fraîcheur du contenu (pages modifiées récemment ou perçues comme obsolètes dans l’index). Google priorise naturellement les pages à forte demande.

Les pages volumineuses impactent négativement le crawl budget. Une page de 2 Mo consomme 40 fois plus de bande passante qu’une page de 50 Ko. Pour un crawl rate limit identique, Google explorera 40 fois moins d’URLs si toutes pèsent 2 Mo. Cette réalité pénalise particulièrement les grands sites avec des milliers de pages : un site de 10000 URLs avec des pages de 2 Mo nécessitera plusieurs semaines pour un crawl complet, contre quelques jours avec des pages de 50 Ko.

Les fichiers robots.txt et sitemaps XML constituent des outils essentiels pour guider Googlebot vers les contenus prioritaires. Le fichier robots.txt bloque l’accès aux URLs de faible valeur (pages admin, résultats de recherche interne, paramètres de tri et filtres redondants), libérant du crawl budget pour les pages stratégiques. Le sitemap.xml liste les URLs importantes avec leur priorité, leur fréquence de mise à jour et leur date de dernière modification. Cette combinaison « crawlez ceci » (sitemap) et « ignorez cela » (robots.txt) optimise l’allocation des ressources de Google.

| Facteur d’optimisation | Impact sur crawl budget | Difficulté implémentation | Priorité |

|---|---|---|---|

| Réduction taille pages HTML | +40% URLs crawlées par jour | Moyenne | Haute |

| Amélioration temps réponse serveur | +30% taux de crawl autorisé | Élevée (infrastructure) | Haute |

| Configuration robots.txt stratégique | +25% crawl budget disponible | Faible | Haute |

| Optimisation sitemap.xml | +20% efficacité découverte URLs | Faible | Moyenne |

| Élimination contenu dupliqué | +35% crawl budget libéré | Moyenne | Haute |

Les données de Crawl Budget Management (Google, 2026) montrent que les sites optimisant leur crawl budget voient une augmentation moyenne de 40% du nombre de pages indexées dans les 30 jours suivant les optimisations. Cette amélioration se traduit par une meilleure visibilité organique et une indexation plus rapide des nouvelles pages.

Cas particuliers et exceptions à connaître

Les PDF conservent une limite de 64 Mo, les ressources CSS et JavaScript sont limitées à 15 Mo au crawl, et les limites s’appliquent aux données non compressées même avec GZIP activé.

Certaines situations techniques nécessitent une attention particulière concernant les limites de Googlebot. Ces cas particuliers concernent des formats spécifiques, des configurations serveur ou des architectures web modernes.

Applications JavaScript (React, Vue.js, Angular)

Les applications JavaScript posent un défi distinct. Le HTML initial de ces applications pèse souvent moins de 10 Ko, mais le contenu réel est généré dynamiquement par JavaScript. Googlebot doit d’abord crawler le HTML, télécharger les bundles JavaScript (soumis à la limite de 15 Mo), exécuter le code, et enfin indexer le DOM résultant. Cette chaîne de traitement introduit des délais et consomme du render budget. La solution recommandée consiste à implémenter le Server-Side Rendering (SSR) ou la Static Site Generation (SSG) pour servir du HTML pré-rendu à Googlebot.

Sites multilingues avec contenu inline

Les sites multilingues incluent parfois toutes les traductions dans le HTML de chaque page, utilisant JavaScript pour afficher la langue appropriée. Cette approche multiplie par le nombre de langues la taille du document HTML. Un site proposant 10 langues avec 200 Ko de contenu par langue génère des pages de 2 Mo, atteignant exactement la limite. La solution consiste à créer des URLs distinctes par langue (approche hreflang) ou à charger les traductions dynamiquement via API.

Pages AMP complexes

Les pages AMP (Accelerated Mobile Pages) sont conçues pour être légères, mais certaines implémentations incluent des composants AMP volumineux (amp-list avec données JSON inline, amp-state avec états d’application complexes). Selon la documentation AMP Project, les pages AMP devraient idéalement rester sous 100 Ko. Si une page AMP dépasse 2 Mo, elle perd son principal avantage : la vitesse.

Flux RSS et XML

Les flux RSS et XML ne sont pas documentés explicitement dans les limites de Googlebot, mais ils suivent vraisemblablement les mêmes contraintes que les fichiers HTML. Les flux RSS volumineux (contenant des centaines d’articles complets avec contenu intégral) peuvent dépasser 2 Mo. La bonne pratique consiste à limiter les flux RSS à 20-50 entrées récentes et à utiliser des résumés plutôt que le contenu complet.

Données structurées schema.org volumineuses

Les données structurées schema.org volumineuses (notamment les markups Product avec des centaines de variantes, ou les markups Recipe avec des instructions détaillées) contribuent à la taille HTML. Un ProductGroup avec 200 variantes peut représenter 100-200 Ko de JSON-LD. Placez ces données structurées en début de document HTML pour garantir leur indexation même si la page approche la limite.

| Type de site/technologie | Risque dépassement limite | Solution recommandée | Exemple concret |

|---|---|---|---|

| Application React/Vue SPA | Faible (HTML initial léger) | SSR/SSG pour Googlebot | Next.js, Nuxt.js, Gatsby |

| Site multilingue inline | Élevé (contenu x langues) | URLs distinctes avec hreflang | exemple.com/fr/, exemple.com/en/ |

| Pages AMP complexes | Modéré | Simplification composants AMP | Limitation amp-list entries |

| Flux RSS exhaustifs | Modéré | Limiter à 50 entrées récentes | RSS avec résumés, pas contenu complet |

| E-commerce avec variantes | Élevé | Pagination + lazy loading variantes | Pages catégories paginées |

Les contenus générés par IA (articles longs créés par GPT-4, Claude ou autres LLM) tendent à être verbeux et peuvent atteindre 5000-10000 mots, soit 30-60 Ko de texte brut. Ce volume reste largement sous la limite, mais combiné à une structure HTML complexe, des données structurées et des scripts intégrés, certaines pages IA-générées approchent 500 Ko. Surveillez ces contenus lors de vos audits.

Points essentiels à retenir

La clarification de Google sur les limites de Googlebot révèle une distinction fondamentale entre exploration et indexation. Pour la grande majorité des sites web avec des pages HTML inférieures à 100 Ko, cette annonce n’a aucun impact pratique. Les sites potentiellement affectés se concentrent dans l’e-commerce avec infinite scroll, les agrégateurs de données et les plateformes d’annonces massives.

La limite de 2 Mo s’applique aux données HTML non compressées. Même avec GZIP ou Brotli activé réduisant la taille de transfert, c’est la version décompressée qui compte pour l’indexation. Les fichiers PDF bénéficient d’une limite plus généreuse de 64 Mo, reflétant leur usage documentaire.

Les solutions d’optimisation incluent la pagination (réduction de 70-90% de la taille), le lazy loading HTML (50-80%), la minification (10-25%) et l’externalisation des images base64 (30-60%). La priorisation du contenu critique en début de document garantit l’indexation des éléments SEO essentiels même si la limite est atteinte.

Le crawl budget reste un facteur déterminant pour les grands sites. Une page de 2 Mo consomme 40 fois plus de ressources qu’une page de 50 Ko, réduisant proportionnellement le nombre d’URLs explorées quotidiennement. L’optimisation du crawl budget via robots.txt, sitemap.xml et réduction de la taille des pages améliore la vitesse d’indexation de 40% selon les données Google 2026.

Les technologies modernes (React, Vue.js, Angular) nécessitent une attention particulière. Le Server-Side Rendering ou la Static Site Generation garantissent que Googlebot accède au contenu complet sans dépendre du render budget limité. Les sites multilingues doivent privilégier les URLs distinctes par langue plutôt que l’intégration de toutes les traductions dans un seul fichier HTML.