Le robots.txt existait bien avant Google. Créé en 1994, standardisé en RFC 9309 en 2022, ce fichier texte d’une poignée de lignes est aujourd’hui au centre d’un débat que personne n’avait anticipé : faut-il laisser les IA entraîner leurs modèles sur votre contenu ? La réponse dépend d’un détail que la plupart des guides ignorent. Chaque grand service IA utilise des user-agents différents selon qu’il crawle pour l’entraînement ou pour répondre à une vraie question d’utilisateur. Bloquer l’un sans connaître l’autre, c’est soit laisser la porte ouverte, soit se couper d’une source de trafic croissante. Ce guide couvre la syntaxe complète, la liste des bots IA actifs en 2026 et les 4 stratégies de configuration selon votre objectif.

Ce que dit le robots.txt : syntaxe et règles de base

Le fichier robots.txt se place à la racine de votre domaine : https://votresite.com/robots.txt. Il est lu avant tout crawl. Un serveur sans robots.txt est interprété comme une autorisation totale.

La syntaxe repose sur trois directives :

- User-agent : identifie le bot ciblé. L’astérisque

*s’applique à tous les bots non listés explicitement. - Disallow : interdit l’accès à un chemin.

Disallow: /bloque tout le site.Disallow: /admin/bloque uniquement ce répertoire. - Allow : autorise explicitement un chemin à l’intérieur d’une zone interdite. Utile pour exposer certaines pages d’un dossier bloqué.

Deux directives complémentaires sont reconnues par la majorité des crawlers sérieux :

- Sitemap : indique l’URL du sitemap XML. Recommandé même si Googlebot le découvre souvent seul.

- Crawl-delay : délai en secondes entre deux requêtes. Ignoré par Googlebot et Bingbot, respecté par certains crawlers tiers.

Exemple de fichier minimal fonctionnel :

User-agent: *

Allow: /

User-agent: GPTBot

Disallow: /

Sitemap: https://votresite.com/sitemap.xmlAttention : les règles sont appliquées dans l’ordre de spécificité. Un bloc User-agent: GPTBot prend le dessus sur le bloc User-agent: * pour GPTBot. Si les deux blocs coexistent avec des règles contradictoires, c’est le bloc le plus spécifique qui s’applique.

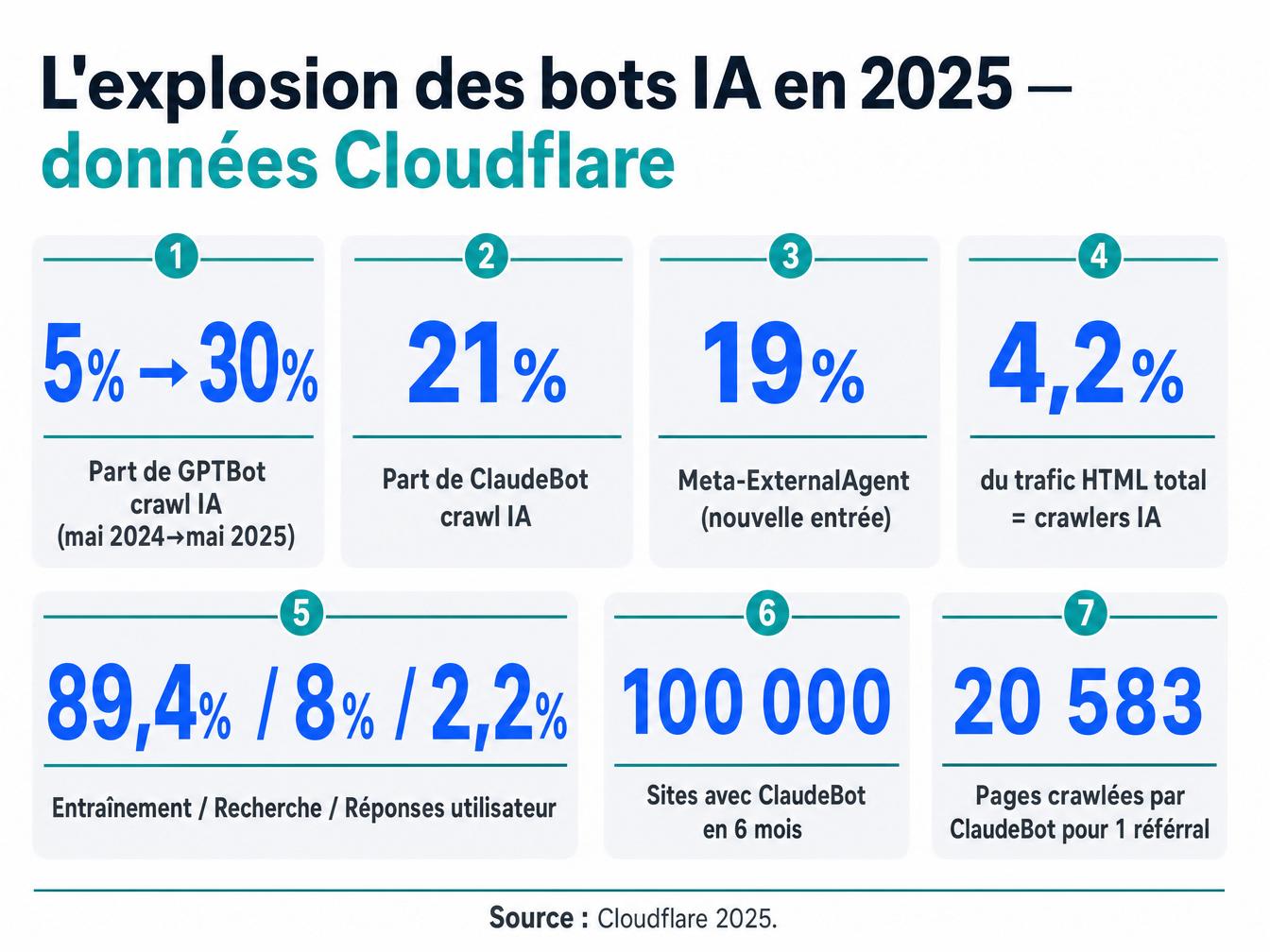

L’explosion des bots IA : ce que montrent les données Cloudflare 2025

Entre mai 2024 et mai 2025, GPTBot est passé de 5% à 30% de part dans le trafic de crawl IA, selon le rapport Cloudflare de juillet 2025 rédigé par João Tomé. ClaudeBot reste à 21%, Meta-ExternalAgent entre directement à 19% en nouvelle entrée. La croissance globale du trafic de crawl IA et search sur la période est de +18%, avec un pic en avril 2025 à +32% par rapport à mai 2024.

Ces chiffres représentent des requêtes réelles mesurées sur le réseau Cloudflare, pas des projections. 4,2% du trafic HTML total transite désormais via des crawlers IA, ce qui semble modeste mais masque une asymétrie : 89,4% de ce trafic sert à entraîner des modèles ou à des usages mixtes, 8% à de la recherche et seulement 2,2% répond à une vraie requête d’utilisateur final.

L’analyse de Paul Calvano (août 2025) sur 12 millions de sites confirme la prise de conscience côté éditeurs : 21% du top 1 000 mondial ont des règles spécifiques pour GPTBot dans leur robots.txt et plus de 560 000 sites mentionnent au moins un bot IA. ClaudeBot est apparu pour la première fois dans les robots.txt en décembre 2023 sur 2 382 sites et était présent sur 100 000 sites dès mai 2024. Six mois pour passer de zéro à 100 000 entrées : aucun autre user-agent n’avait connu cette courbe.

La liste complète des bots IA à connaître en 2026

Chaque service IA majeur déploie plusieurs user-agents selon l’usage. C’est le point que la plupart des guides simplifiés ratent : bloquer ClaudeBot n’empêche pas Anthropic d’accéder à votre site via Claude-SearchBot pour répondre aux questions de ses utilisateurs.

| Service | User-agent (entraînement) | User-agent (search / réponses) | Respecte robots.txt |

|---|---|---|---|

| OpenAI (ChatGPT) | GPTBot | OAI-SearchBot, ChatGPT-User | Oui |

| Anthropic (Claude) | ClaudeBot, anthropic-ai | Claude-SearchBot, Claude-User | Oui |

| Perplexity | PerplexityBot | Perplexity-User | Oui |

| Google (Gemini) | Google-Extended | GoogleOther, Googlebot | Oui |

| Meta | Meta-ExternalAgent | Meta-ExternalFetcher | Oui |

| Apple | Applebot-Extended | Applebot | Oui |

| Amazon | Amazonbot | (aucun bot search déclaré) | Oui |

| Common Crawl | CCBot | (aucun bot search déclaré) | Variable |

La distinction entraînement vs search a une conséquence directe : si vous bloquez GPTBot mais laissez ChatGPT-User, votre contenu ne servira pas à entraîner le modèle mais apparaîtra quand même dans les réponses de ChatGPT Search. C’est une décision de business, pas un bug de configuration.

Les 4 stratégies de configuration selon votre objectif

Quatre configurations couvrent la majorité des besoins. Choisissez en fonction de ce que vous voulez protéger, pas par réflexe.

Stratégie 1 : tout autoriser (défaut)

Ne rien ajouter pour les bots IA revient à tout autoriser. Adapté si vous voulez maximiser votre présence dans les réponses IA et si la question de l’entraînement ne pose pas de problème éthique ou commercial. C’est le comportement implicite du robots.txt.

User-agent: *

Allow: /

Sitemap: https://votresite.com/sitemap.xmlStratégie 2 : bloquer uniquement l’entraînement, autoriser la search IA

C’est la configuration la plus répandue chez les éditeurs en 2026. Vous bloquez les bots d’entraînement (GPTBot, ClaudeBot, anthropic-ai, Google-Extended, CCBot) mais laissez passer les bots de recherche (ChatGPT-User, Claude-SearchBot, PerplexityBot). Votre contenu reste visible dans Perplexity, ChatGPT Search et Claude, sans alimenter les datasets d’entraînement.

User-agent: *

Allow: /

# Bloquer l'entraînement OpenAI

User-agent: GPTBot

Disallow: /

# Bloquer l'entraînement Anthropic

User-agent: ClaudeBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

# Bloquer l'entraînement Google Gemini

User-agent: Google-Extended

Disallow: /

# Bloquer l'entraînement Meta

User-agent: Meta-ExternalAgent

Disallow: /

# Bloquer Common Crawl (utilisé par plusieurs modèles)

User-agent: CCBot

Disallow: /

# Laisser passer les bots search IA

User-agent: OAI-SearchBot

Allow: /

User-agent: ChatGPT-User

Allow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: Perplexity-User

Allow: /

Sitemap: https://votresite.com/sitemap.xmlStratégie 3 : bloquer tous les bots IA

Adapté si vous avez des raisons légales ou contractuelles de ne pas exposer votre contenu à des services IA. Attention : cette stratégie vous exclut aussi des résultats de ChatGPT Search, Perplexity et Claude, un canal de trafic qui croît rapidement.

User-agent: GPTBot

Disallow: /

User-agent: OAI-SearchBot

Disallow: /

User-agent: ChatGPT-User

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

User-agent: Claude-SearchBot

Disallow: /

User-agent: Claude-User

Disallow: /

User-agent: PerplexityBot

Disallow: /

User-agent: Perplexity-User

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: Meta-ExternalAgent

Disallow: /

User-agent: CCBot

Disallow: /Stratégie 4 : protéger certaines sections seulement

Utile si vous avez du contenu premium ou propriétaire dans un sous-répertoire spécifique. Vous bloquez les bots IA uniquement sur ces chemins.

User-agent: GPTBot

Disallow: /premium/

Disallow: /membres/

Disallow: /rapports/

User-agent: ClaudeBot

Disallow: /premium/

Disallow: /membres/

Disallow: /rapports/Robots.txt et SEO classique : ce qu’il ne faut pas toucher

Les erreurs de configuration robots.txt sur les bots SEO ont des conséquences immédiates sur l’indexation. Quelques règles absolues :

Ne jamais bloquer Googlebot. Un Disallow: / sur User-agent: Googlebot désindexe intégralement votre site. Google Search Console affiche une alerte mais la désindexation peut précéder la détection de plusieurs jours.

Ne pas confondre crawl et indexation. Bloquer le crawl via robots.txt n’empêche pas une page d’apparaître dans les résultats si elle est liée depuis une autre page déjà indexée. Pour exclure une page de l’index, utilisez la balise meta <meta name="robots" content="noindex"> dans le <head>.

Les ressources CSS et JavaScript ne doivent pas être bloquées au crawl. Google a besoin de les rendre pour évaluer correctement la page. Une erreur fréquente consiste à bloquer /wp-content/ ou /assets/ pour réduire le crawl budget, ce qui dégrade le rendu et peut pénaliser le score de la page.

Le crawl budget, c’est-à-dire la fréquence et le volume de crawl que Googlebot alloue à votre site, n’est pas directement contrôlable via robots.txt. Bloquer des pages sans valeur SEO (pages de connexion, pages de recherche interne, paramètres d’URL dynamiques) peut en revanche orienter le crawl vers vos pages importantes.

Les limites du robots.txt : ce qu’il ne peut pas faire

Le robots.txt repose sur la bonne volonté du crawler. Les bots déclarés des grandes plateformes (OpenAI, Anthropic, Google, Perplexity) respectent les directives, ce qui est vérifiable dans les logs serveur. Mais un crawler malveillant, un scraper non déclaré ou un bot qui ne s’identifie pas avec son user-agent officiel passera outre sans difficulté.

Pour une protection plus robuste, plusieurs options complémentaires existent : le blocage par IP (Cloudflare publie les plages d’IP de GPTBot), les en-têtes HTTP X-Robots-Tag (équivalent du robots.txt au niveau de la réponse HTTP, utile pour les PDFs et fichiers non-HTML) et l’authentification sur les sections sensibles.

Le ratio de ClaudeBot est parlant : 20 583 pages crawlées pour chaque référral généré vers les éditeurs, d’après les données citées dans plusieurs analyses de trafic 2025. Ce chiffre pose directement la question de la réciprocité entre les crawlers et les éditeurs.

Comment tester et valider votre robots.txt

Quatre outils couvrent l’essentiel des vérifications :

- Google Search Console > Outils > Testeur robots.txt : simulez le comportement de Googlebot sur n’importe quel chemin. Accessible via search.google.com/search-console.

- Bing Webmaster Tools : équivalent Microsoft, avec simulation pour Bingbot.

- robots.txt Checker (Technical SEO) : outil tiers gratuit, teste plusieurs user-agents simultanément.

- Logs serveur : la seule vérification irréfutable. Filtrez par user-agent pour confirmer que GPTBot ne passe plus après modification.

Après toute modification du robots.txt, soumettez l’URL https://votresite.com/robots.txt via l’outil d’inspection d’URL de Google Search Console pour forcer la mise en cache de la nouvelle version. Googlebot met en cache le robots.txt pendant 24 heures par défaut. Sans soumission manuelle, un crawl peut utiliser l’ancienne version pendant une journée entière.

Erreurs courantes à éviter

Quelques pièges récurrents que les logs révèlent en pratique :

Bloquer l’URL du sitemap. Si votre sitemap se trouve dans un dossier bloqué, Googlebot ne peut pas le lire. Vérifiez que Disallow: /wp-admin/ n’intercepte pas un sitemap placé à /wp-admin/sitemap.xml, peu probable mais vu en production.

Utiliser des expressions régulières non supportées. Le robots.txt n’accepte que le caractère générique * dans les chemins et le symbole $ pour indiquer la fin d’une URL. Les regex complexes sont ignorées par la plupart des crawlers. Une règle Disallow: /*.pdf$ fonctionne ; une règle Disallow: /page-[0-9]+/ ne sera pas interprétée correctement.

Confondre les user-agents proches. Googlebot crawle pour l’index principal. Google-Extended est le bot d’entraînement Gemini. Googlebot-Image crawle spécifiquement les images. Bloquer Googlebot en voulant bloquer Google-Extended est une erreur qui arrive, surtout avec des configurations copiées en ligne.

Ne pas documenter les modifications. Le robots.txt n’a pas d’historique natif. Versionnez le fichier dans Git ou notez les modifications avec leur date dans un commentaire en haut du fichier via le caractère #.

Vérifiez votre robots.txt dans Google Search Console après chaque mise en production. Si un crawl de validation confirme que les bots IA ne passent plus et que Googlebot accède correctement à vos pages prioritaires, votre configuration est en place.